Microsoft Mantém Tecnologia de Vídeo IA Avançada em Segredo

4/23/2024

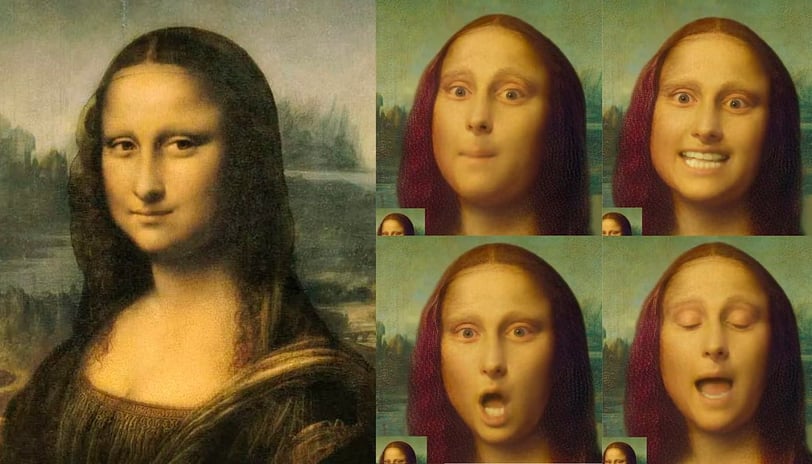

A Microsoft revelou sua mais recente inovação em inteligência artificial, o VASA-1, que tem a capacidade de criar vídeos ultrarrealistas de pessoas a partir de uma simples foto. No entanto, devido ao potencial perigoso dessa tecnologia, a empresa optou por não torná-la acessível ao público por enquanto.

O Desafio Ético da IA na Criação de Vídeos

O VASA-1 pode gerar vídeos de pessoas conversando utilizando apenas uma imagem estática e um arquivo de áudio, acompanhados de um pequeno fragmento de texto. Embora os vídeos produzidos sejam tecnicamente falsos, eles aparecem com uma realidade impressionante que pode enganar facilmente os usuários. Devido a essas características, a Federal Trade Commission (FTC) classificou esse tipo de conteúdo como potencialmente perigoso, principalmente pelo risco de fraudes associadas a deepfakes.

Microsoft e a Conscientização Sobre o Uso Responsável da IA

Os desenvolvedores da Microsoft enfatizam que o objetivo do VASA-1 é explorar a criação de avatares virtuais interativos, destinados a aplicações benéficas como melhoria da comunicação digital, acessibilidade para deficientes visuais, educação e apoio terapêutico. A empresa está ciente dos riscos associados e tem planos de usar essa tecnologia para aprimorar a detecção de deepfakes, ao invés de permitir usos que possam enganar as pessoas.

Desafios Regulatórios e Opiniões Externas

A decisão da Microsoft de restringir o acesso ao VASA-1 levanta questões sobre a auto-regulação e a eficácia das medidas de segurança adotadas pelas empresas de tecnologia. Especialistas como Kevin Surace, presidente da Token, expressam preocupações sobre o atraso na implementação de controles adequados em IA até que as questões de proteção de dados sejam resolvidas. Além disso, diferentes países estão tentando regular a criação e o uso de deepfakes por meio de leis que protegem os direitos dos indivíduos.

O Futuro da IA e a Segurança Pública

Em um recente depoimento no Senado dos Estados Unidos, Rijul Gupta, CEO da DeepMedia, destacou os perigos dos deepfakes, apontando que eles podem minar a confiança pública e ameaçar os fundamentos da democracia. A discussão sobre a regulamentação e o uso ético da IA continua a ser um tópico quente no campo tecnológico e político, exigindo um equilíbrio cuidadoso entre inovação e segurança pública.